Il s'est passé quelque chose avec l'APC en août 2025 — Google Trends l'a vu

Les données d’abord

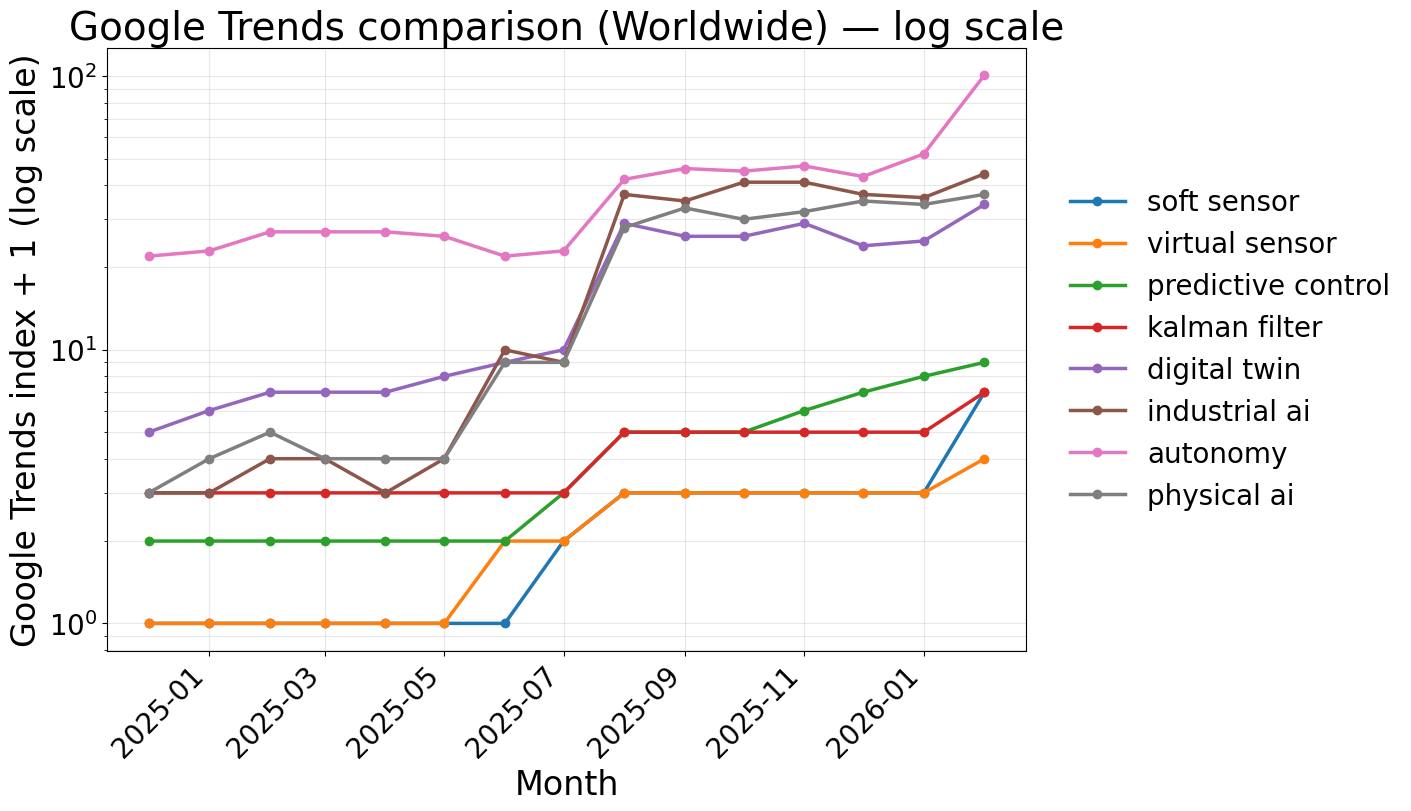

Je consultais les données Google Trends pour les termes avec lesquels je travaille au quotidien — advanced process control, soft sensor, virtual sensor, predictive control, digital twin, Kalman filter — lorsque j’ai remarqué quelque chose d’inhabituel.

Pendant une vingtaine d’années — de 2004 à mi-2025 — ces termes étaient essentiellement stables. Quelques ingénieurs, quelques chercheurs, un bourdonnement prévisible d’intérêt de niche. Puis, en l’espace d’un seul mois, la tendance a rompu.

Google Trends, mondial, échelle logarithmique. Toutes les valeurs sont normalisées de 0 à 100 par rapport au pic. L’axe vertical est logarithmique — une progression de 1 à 6 représente la même distance visuelle qu’une progression de 6 à 36.

Les chiffres bruts extraits de Trends :

| Terme | Mai 2025 | Juin 2025 | Juil. 2025 | Août 2025 | Variation Juin→Août |

|---|---|---|---|---|---|

| digital twin | 20 | 24 | 26 | 84 | +3,5× |

| predictive control | 3 | 4 | 5 | 13 | +3,3× |

| Kalman filter | 6 | 6 | 6 | 12 | +2× |

| soft sensor | 1 | 1 | 2 | 6 | +6× |

| virtual sensor | 1 | 2 | 2 | 7 | +3,5× |

| advanced process control | 1 | 1 | 1 | 6 | +6× |

Et ce pic ne s’est pas effondré. En février 2026, predictive control atteignait un nouveau record historique sur l’indice. Digital twin est resté à un niveau élevé pendant sept mois consécutifs. Quelque chose de structurel a changé.

Une mise en garde avant d’aller plus loin : Google Trends affiche des volumes de recherche relatifs, normalisés à 100 au pic. Il ne communique pas de chiffres absolus. Un terme qui double de 500 à 1 000 recherches produit la même courbe que celui qui passe de 50 000 à 100 000. Ce qui rend ces données remarquables, c’est la synchronisation : plusieurs termes indépendants, techniquement spécifiques, qui bougent tous dans le même mois. Cela pointe vers une cause systémique.

Vingt ans de stabilité. Puis une falaise.

Avant de tirer des conclusions, le contexte historique s’impose.

Predictive control était déjà recherché en 2004. Digital twin progressait lentement depuis 2017. Kalman filter est un terme de niche stable depuis des décennies. Ce ne sont pas des concepts nouveaux qui seraient devenus viraux. Ce sont des disciplines d’ingénierie matures, avec des audiences établies et largement statiques.

Que tous ces termes bondissent simultanément, dans le même mois, est suffisamment inhabituel pour mériter une explication. Mon interprétation : la vague physical AI de 2025 a — pour la première fois — arraché le domaine de la régulation industrielle à l’obscurité des spécialistes pour le projeter dans la conversation ingénierie grand public.

Mon analyse : les termes liés à l’APC ont progressé avant tout par effet de second ordre d’un basculement public bien plus large autour de l’IA physique, des opérations autonomes et des jumeaux numériques. Le vocabulaire classique de la régulation a été porté vers le haut par un récit plus large. La montée des termes chapeau (digital twin, industrial AI, autonomy) est venue en premier ; celle des méthodes techniques sous-jacentes (predictive control, soft sensor, Kalman filter) a suivi.

Cela dit, c’est une interprétation fondée sur la chronologie et les annonces publiques, pas une preuve de l’intention des chercheurs.

La chronologie : de janvier à août 2025

Le saut d’août ne s’est pas produit du jour au lendemain. En retraçant les événements publics depuis le début de 2025, on distingue quatre phases d’accumulation.

Janvier–mars : l’amorçage

Deux événements ont reconfiguré les attentes en janvier.

Le 6 janvier, Jensen Huang a profité du CES pour dévoiler NVIDIA Cosmos — un modèle de fondation entraîné sur 20 millions d’heures de vidéos de systèmes physiques — et a déclaré : “L’IA physique va révolutionner les industries manufacturières et logistiques représentant $50 000 milliards.” L’IA physique n’était plus une catégorie de recherche. C’était une feuille de route produit.

Deux semaines plus tard, DeepSeek R1 est sorti. Son effet réel sur l’IA industrielle a été le suivant : il a brisé le postulat selon lequel l’IA avancée nécessitait une infrastructure cloud coûteuse. Des ingénieurs de procédés à qui l’on avait dit que l’intégration de l’IA exigeait des abonnements Azure et des clusters GPU se sont soudain posé la question : est-ce que ça peut tourner sur une passerelle industrielle edge ?

À GTC 2025 en mars, NVIDIA a placé les jumeaux numériques industriels au centre de son keynote : des blueprints Omniverse pour la conception d’usines IA, Isaac GR00T N1 pour les robots humanoïdes, et le moteur physique Newton co-développé avec Google DeepMind et Disney Research. Foxconn, BMW, TSMC et Toyota étaient tous présentés en train de construire des jumeaux numériques à l’échelle de l’usine. Schneider Electric et ETAP ont lancé un jumeau numérique d’infrastructure électrique basé sur la physique lors de la conférence.

Le message reçu par les ingénieurs de procédés qui observaient de loin : la méthodologie de simulation de votre industrie vient d’être adoptée à grande échelle par le monde de l’électronique grand public.

Mai : l’IA physique devient une catégorie produit

18 mai — Le keynote COMPUTEX de NVIDIA a présenté Isaac GR00T N1.5 et GR00T-Dreams, un pipeline générant des données d’entraînement robotique à partir de séquences simulées, comme des “rêves”, plutôt que de démonstrations physiques. Les ingénieurs travaillant avec des capteurs virtuels (soft sensors) ont immédiatement reconnu le parallèle : la génération de données de procédé synthétiques pour l’entraînement de modèles est exactement le même concept, appliqué aux modèles de procédés depuis des décennies.

19/21 mai — Microsoft a annoncé Digital Twin Builder dans Fabric Real-Time Intelligence — un outil low-code/no-code pour construire des jumeaux numériques, inclus dans les abonnements Fabric existants. La cible n’était pas les spécialistes de la simulation, mais les analystes opérationnels et les ingénieurs données qui disposaient déjà d’Azure et se trouvaient soudain sur un chemin direct vers des jumeaux numériques opérationnels. Lorsqu’un tel outil est mis sur le marché, les termes chapeau progressent avant que les termes techniques de fond ne suivent.

Juin : l’autonomie entre dans les opérations industrielles

C’est le mois où le récit est devenu explicitement pertinent pour la régulation de procédés.

Le contexte financier se précisait également : des analystes de marché publiaient en juin 2025 des projections plaçant le secteur mondial de l’APC à 10,3 milliards de dollars d’ici 2034, portées explicitement par l’intégration de l’IA et de l’IoT. Un titre de ce type attire des audiences non spécialistes — équipes achats, investisseurs, consultants en management — qui recherchent ensuite le vocabulaire sous-jacent.

3 juin — Yokogawa a lancé la nouvelle génération de CENTUM VP en la cadrant explicitement autour des opérations autonomes durables, décrivant la transition sectorielle de l’automatisation vers l’autonomie.

9 juin — Lors de son Users Group annuel à San Antonio, Honeywell a lancé son nouveau portefeuille IA sous la bannière “De l’automatisation à l’autonomie” — phrase qui a coiffé leur communiqué de presse et structuré l’ensemble de l’annonce produit. Le programme de la conférence regroupait commande avancée de procédé (Advanced Process Control), jumeaux numériques de procédé (Process Digital Twin) et IA / Opérations autonomes (AI/Autonomous Operations) dans le même track — inhabituel par rapport aux années précédentes. Honeywell a lancé sa Suite Digitale activée par l’IA et Digital Cognition : des agents IA faisant tourner des jumeaux numériques de procédé pour fournir des orientations opérationnelles en temps réel. L’Autonomous Operations Assistant était positionné comme un logiciel fonctionnant pour le compte de chaque opérateur de salle de contrôle.

L’Honeywell Users Group touche des dizaines de milliers d’ingénieurs de procédés dans le raffinage, la chimie et le GNL. Placer l’APC et les opérations autonomes dans la même conversation a généré des recherches de la base installée de Honeywell cherchant à comprendre en quoi consiste concrètement le socle technique de l‘“autonomie”.

11 juin — NVIDIA a publié ses ambitions en matière d’IA industrielle en Allemagne, reliant usines IA, fabrication, robotique et IA physique pour le public ingénieur européen.

18 juin — Yokogawa et Shell ont annoncé un accord formel pour des robots à vision IA dans la maintenance autonome de site industriel. Le détail crucial : lorsque les données capteurs acquises par les robots se connectaient au système de régulation de l’installation, elles renvoyaient des instructions vers la boucle de régulation — exactement l’interface entre la mesure virtuelle et la commande de procédé que les ingénieurs APC théorisaient depuis des années, désormais déployée par une grande compagnie pétrolière en collaboration avec un grand fournisseur de DCS.

Juillet : le lien direct avec l’APC

22 juillet — La division AspenTech d’Emerson et TotalEnergies ont annoncé une collaboration stratégique mondiale couvrant trois technologies spécifiques : Aspen Inmation (infrastructure de données industrielles) sur tous les sites TotalEnergies dans le monde, Aspen DMC3 (commande prédictive basée sur modèle, MPC) sur l’ensemble des opérations Exploration & Production, et Aspen GDOT (optimiseur temps réel en boucle fermée) sur plusieurs sites de raffinage.

TotalEnergies est l’une des plus grandes compagnies énergétiques intégrées au monde. Un engagement formel en faveur d’un déploiement MPC à l’échelle de l’entreprise — avec nommément les produits concernés — n’est pas une nouvelle anodine. Cela a immédiatement suscité des recherches de la part d’ingénieurs de sociétés concurrentes, des équipes clients des fournisseurs de DCS, et de toute personne cherchant à comprendre quelle architecture TotalEnergies était en train de construire et pourquoi.

Cette annonce s’aligne étroitement avec la remontée de predictive control et advanced process control visible dans les données juste avant août.

Également en juillet — À l’autre extrémité du spectre, Trend Micro a lancé un modèle de cybersécurité basé sur des capacités de jumeau numérique pour simuler des menaces. Cela a élargi l’audience des recherches sur “digital twin” au-delà des ingénieurs de procédés, contribuant à la progression continue du terme avant le pic d’août.

Août : la rupture

Trois événements ont convergé en août.

6 août — Imubit a publié “APC Meets AI”, un article recadrant explicitement la commande avancée de procédé (APC) sous le prisme de l’IA. C’est notable car il provenait d’un fournisseur spécialisé en APC, et non d’un média tech généraliste — signal que l’industrie APC elle-même commençait à reformuler son travail dans le vocabulaire de l’IA, accessible à un public plus large.

8 août — NVIDIA a publié “Physical AI Accelerated by Three NVIDIA Computers for Robot Training, Simulation and Inference”, affirmant explicitement que l’IA physique connaît son moment de rupture et décrivant la chaîne entraînement-simulation-inférence pour les systèmes physiques autonomes. Ce post a été largement partagé dans les communautés d’ingénieurs.

11 août — Au SIGGRAPH 2025, NVIDIA a dévoilé Cosmos Reason (un modèle de langage visuel pour la compréhension de la physique), NuRec (Gaussian splatting 3D pour la reconstruction à grande échelle de sites à partir de données capteurs), et Isaac Sim 5.0 (en open source). L’annonce NuRec était particulièrement pertinente pour les industries de procédés : convertir des scans lidar et caméra de sites industriels en modèles 3D vivants connectés aux données de procédé est précisément le pipeline qui alimente les jumeaux numériques de procédé opérationnels.

12 août — Ansys et NVIDIA ont annoncé qu’Ansys Fluent — l’outil CFD dominant dans les industries de procédés — intégrerait directement NVIDIA Omniverse. Les ingénieurs qui modélisent les écoulements en réacteur, la dynamique des échangeurs de chaleur et les processus de combustion dans Fluent ont obtenu un accès direct depuis leurs modèles de simulation vers des jumeaux numériques opérationnels.

25 août — NVIDIA a lancé Jetson AGX Thor (IA edge de classe Blackwell, 2 070 téraflops FP4 à $3 499) avec Caterpillar et Hexagon parmi les premiers adoptants. L’inférence de capteurs virtuels (soft sensors) en temps réel sur du matériel déployé sur le terrain est devenue économiquement crédible.

À la fin août, l’IA physique, les jumeaux numériques, la simulation et l’infrastructure IA industrielle n’étaient plus des récits parallèles. Ils avaient convergé en une narrative cohérente que les ingénieurs, les équipes opérationnelles et la direction pouvaient tous reconnaître simultanément.

Pourquoi chaque terme a bougé

La chaîne causale diffère légèrement pour chaque terme :

Digital twin a surfé sur la plus grande vague car il était nommé explicitement dans presque toutes les annonces — Honeywell, Microsoft, NVIDIA, Ansys, Yokogawa, TotalEnergies. En août, de multiples fils narratifs indépendants convergeaient sur le même mot.

Advanced process control / predictive control a bondi le plus directement sur l’annonce TotalEnergies/AspenTech. Une entreprise de cette envergure citant des produits MPC spécifiques dans un communiqué de presse a suscité des recherches des équipes ingénierie et achats des entreprises comparables.

Soft sensor / virtual sensor a progressé par effet de second ordre. Un MPC à grande échelle nécessite des estimations continues de variables de qualité de procédé non mesurées — c’est précisément ce que fournissent les capteurs virtuels (soft sensors). Lorsque les ingénieurs étudient DMC3, ils trouvent les soft sensors. Lorsqu’ils lisent sur la maintenance autonome de site par vision IA de Yokogawa, ils reconnaissent la mesure virtuelle. Le fil du filtre de Kalman et de l’estimation d’état traverse tout cela.

Kalman filter a connu une hausse plus modeste mais réelle, portée par deux mécanismes : les algorithmes d’estimation d’état sous-jacents aux plateformes robotiques NVIDIA (la fusion capteurs dans Isaac utilise les filtres de Kalman étendu et non parfumé), et une vague de recherche sur les architectures hybrides neural-Kalman pour véhicules autonomes générant une couverture presse significative à mi-2025.

Une hypothèse alternative à considérer

Une explication que je n’ai pas vue clairement réfutée : l’expansion du mode IA de Google à mi-2025. Lorsque Google a déployé ses capacités de recherche approfondie alimentées par l’IA via Search Labs, les ingénieurs explorant des sujets complexes via des requêtes conversationnelles ont pu générer des chaînes de recherche techniques — notamment “predictive control”, “Kalman filter”, “soft sensor” — qui n’auraient pas figuré dans les journaux de recherche traditionnels. Si le déploiement du mode IA a coïncidé avec août 2025, une partie du saut dans Trends pourrait refléter un changement dans la façon dont les gens cherchent plutôt que (ou en plus de) dans ce qu’ils cherchent. Je ne peux pas confirmer le calendrier exact du déploiement, mais c’est un facteur contributif plausible qui mérite d’être examiné.

Ce que je crois qu’il se passe réellement

Le schéma général ressemble à ce qui s’est produit avec le cloud computing vers 2010–2012 et avec le machine learning vers 2015–2017. Dans chaque cas, des techniques appliquées discrètement dans des industries de niche pendant des années ont été reformatées et adoptées à grande échelle par des industries adjacentes — et la visibilité résultante a entraîné les recherches spécialisées d’origine dans son sillage.

L’industrie de procédés fait tourner la régulation à base de modèles, l’estimation d’état, la mesure virtuelle et l’optimisation temps réel depuis les années 1980. Des raffineries avec une couverture MPC complète, des capteurs virtuels inférant la qualité de polymères, des filtres de Kalman estimant les concentrations en réacteur — rien de tout cela n’est nouveau.

Ce qui est nouveau, c’est que la vague de l’IA physique a placé exactement cette pile — modèle, estimateur d’état, optimiseur — au centre du discours ingénierie grand public. Le cadrage de Jensen Huang “ordinateur d’entraînement, ordinateur de simulation, ordinateur d’IA physique” est structurellement identique à ce que les ingénieurs APC appellent l’architecture modèle, estimateur d’état, régulateur. Le vocabulaire est différent ; la structure sous-jacente est la même.

L’élévation soutenue jusqu’à fin 2025 et dans 2026 suggère que ce n’est pas un pic d’engouement temporaire. L’indice predictive control atteignant son record historique en février 2026 — six mois après le saut d’août — pointe vers quelque chose de structurel : un public d’ingénieurs plus large a découvert le domaine et ne s’est pas volatilisé.

Que cela se traduise par des investissements réels dans des projets est une question distincte. Mais la découverte, elle, est réelle.

Un signal institutionnel vient appuyer la thèse structurelle : en septembre 2025, le Forum économique mondial a publié Physical AI: Powering the New Age of Industrial Operations avec le Boston Consulting Group, codifiant formellement l‘“IA physique” comme couche de convergence entre l’intelligence numérique et l’autonomie physique. Des documents à ce niveau se propagent via les briefings exécutifs et les thèses d’investissement — traduisant l’intérêt des ingénieurs en vocabulaire de salle de conseil. L’élévation soutenue des recherches liées à l’APC jusqu’à fin 2025 reflète probablement, en partie, cette seconde vague de propagation.

Et vous, qu’en pensez-vous ?

Je suis sincèrement curieux de savoir si cela correspond à ce que vous observez de votre côté.

Avez-vous reçu davantage d’appels d’offres ou de demandes mentionnant jumeau numérique, opérations autonomes ou IA physique depuis mi-2025 ? Avez-vous eu à expliquer en quoi votre travail sur la MPC ou les capteurs virtuels (soft sensors) se rattachait à ce qui a été annoncé au GTC ou à l’Honeywell Users Group ? Vos clients formulent-ils leurs demandes différemment d’il y a deux ans ?

Je suis également preneur d’autres explications. L’annonce TotalEnergies/AspenTech s’aligne bien avec la hausse de predictive control, mais elle n’est peut-être pas le moteur principal pour les autres termes. Et le cluster NVIDIA d’août est le signal public le plus fort, mais une partie des recherches effectives a pu être déclenchée par des événements que je n’ai pas identifiés — mandats internes, roadshows fournisseurs, un fil LinkedIn qui s’est propagé, un article spécifique.

Je lis chaque message et réponds à ceux qui enrichissent ma compréhension. Si suffisamment de personnes partagent des observations qui méritent d’être synthétisées, j’écrirai un article de suivi.

À lire ensuite

Si cet article vous a donné envie de comprendre comment la commande prédictive, les capteurs virtuels ou l’estimation d’état fonctionnent concrètement, la section des design patterns couvre les méthodologies sous-jacentes :

Des analyses structurées de la commande prédictive basée sur modèle (MPC), du filtrage de Kalman, de la conception de capteurs virtuels (soft sensors) et de l’optimisation temps réel — la pile technique derrière les tendances de recherche ci-dessus.

Dr. Rafał Noga est consultant indépendant spécialisé en commande avancée de procédé, capteurs virtuels / soft sensors et estimation d’état pour les procédés industriels. Il intervient dans les domaines de la chimie, de la pharmacie, de l’énergie et des applications aéronautiques.

Have a project or a question?

Contact Dr. Noga →